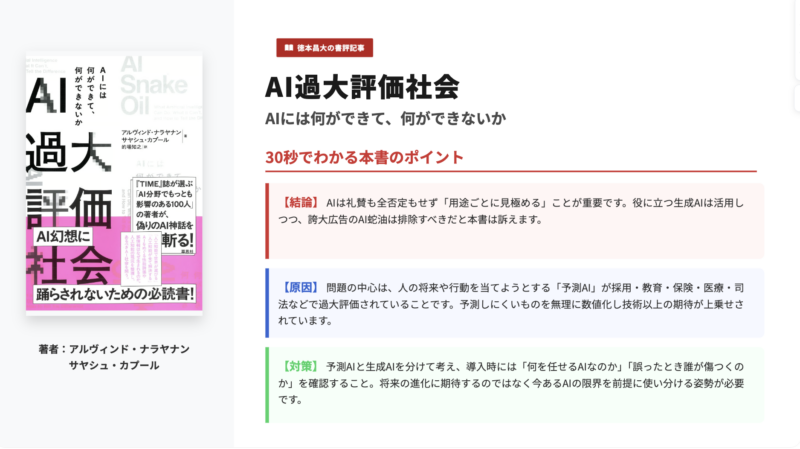

書籍:AI過大評価社会:AIには何ができて、何ができないか

著者:アルヴィンド・ナラヤナン, サヤシュ・カプール

出版社:草思社

ASIN : B0GY8C86WD

30秒でわかる本書のポイント

【結論】: AIは礼賛も全否定もせず、「用途ごとに見極める」ことが重要です。役に立つ生成AIは活用しつつ、誇大広告のAI蛇油は排除すべきだと本書は訴えます。

【原因】: 問題の中心は、人の将来や行動を当てようとする「予測AI」が、採用・教育・保険・医療・司法などで過大評価されていることです。予測しにくいものを無理に数値化し、技術以上の期待が上乗せされています。

【対策】 :予測AIと生成AIを分けて考え、導入時には「何を任せるAIなのか」「誤ったとき誰が傷つくのか」を確認すること。将来の進化に期待するのではなく、今あるAIの限界を前提に使い分ける姿勢が必要です。

本書の要約

本書は、AIを無条件に礼賛も否定もしない立場から、予測AIと生成AIを分けて考える重要性を示す一冊です。とくに採用、教育、医療、司法などで使われる予測AIは、そもそも人間の将来や行動を正確に当てにくく、誇大宣伝のまま導入されると深刻な不利益を生みます。一方、生成AIには文章作成、要約、翻訳、発想支援など知的作業を助ける現実的な価値があります。「AI蛇油」を見抜き、用途ごとに限界と効用を見極めるリテラシーの必要性を説く本です。

おすすめの人

・AIへの期待と不安を整理したい人

・生成AIの活用範囲を冷静に見極めたい人

・採用・人事・教育・医療・行政に関わる実務家

・テック企業の宣伝文句を鵜呑みにしたくない人

・AI時代の判断基準を持ちたい経営者・リーダー

本書から得られるメリット

・AIは大きく「予測AI」と「生成AI」に分けて考える必要がある

・とくに予測AIは、採用・教育・医療・司法などで過大評価されやすい

・予測しにくい対象は、データを増やしても本質的に当てにくい場合が多い

・不完全な予測AIの導入コストは、企業ではなく現場の人間が負いやすい

・本書は生成AIまで一括りに否定せず、現実的な活用価値を認めている

予測AIと生成AIを分けて考える

AI蛇油とは、宣伝通りに機能しない、そのように機能するはずがないAIのことだ。(アルヴィンド・ナラヤナン, サヤシュ・カプール)

「AIを導入すれば未来が予測でき、最適な判断が下せる」——こうした万能感に近い期待が社会を覆っています。しかし、現在のAIブームには危うい過大評価が潜んでいるのではないでしょうか。

AIの本質はあくまで「過去の統計」であり、不連続な未来の創造や、数値化できない人間的な文脈(コンテキスト)の理解には限界があります。熱狂のなかでこそ、AIを万能の神としてではなく、思考を拡張する「高度な道具」として冷静に見極める視点が求められています。

プリンストン大学のコンピューター科学者のアルヴィンド・ナラヤナンとサヤシュ・カプールのAI過大評価社会:AIには何ができて、何ができないか(原題:AI Snake Oil)』は、AIの現状と未来をわかりやすく解き明かす一冊です。

AI蛇油(Snake Oil )は、効能のない万能薬として売られていた「インチキ薬」を意味します。著者が問題にしているのは、AIが優れているか否かという論争ではありません。AIが「できること」の理解が歪んだまま、企業や公共機関の意思決定の仕組みに組み込まれていることです。

本書の中心メッセージは明快です。AIの危険は、AIそのものよりも、AIをめぐる誤解と誇張にあります。できることの範囲が曖昧なまま、AIが「正しそうに見える」形で運用される。そこから被害が生まれることをケーススタディから明らかにします。

不確実な未来を「当てたい」という人間の欲求が強いほど、現実には予測可能性が低くなりがちです。にもかかわらず、AIという言葉が付くことで、予測があたかも正しいものに扱われてしまう。これがAIスネークオイルの実態です。

著者たちはAIを「生成AI」「予測AI」「コンテンツモデレーションAI」に分けて、整理します。AI議論が混乱しやすいのは、異なる性質のものを同じ「AI」と呼び、同じ基準で評価してしまうからです。

・文章や画像やコードを生成し、知的作業を支援する生成AI。

・過去データから未来を推定し、スコア化や選別に使われやすい予測AI。

・SNSの投稿チェックに使われるコンテンツモデレーションAI。

現場の導入判断で最も問題になりやすいのは、予測AIであるというのが著者たちの主張です。 企業はしばしば、「この人は優秀な社員になるか」「この生徒は将来成功するか」「この患者はリスクが高いか」といった判断までAIでできるかのように語ります。メディアが最新のAI技術や商品の素晴らしさをPRすることで、導入企業は期待値を高めます。

AIの専門家には、誇大広告の出どころが研究者であれ、企業であれ、メディアであれ、これらに対する批判の声をあげる責任がある。

著者たちは、予測AIにできることとできないことを明らかにすべきだと言います。「誰が将来成功するか」「どの学生が伸びるか」「この人は再犯するか」。こうした問いは、当たれば確かに大きな効果を企業にもたらしますが、予測AIの精度はまだまだレベルが低いと言うのが実態です。

採用や教育、司法、医療、保険のようにAIの判定が人生を左右する場面で使われ始めると、そのリスクの矛先は組織ではなく、常に「判定される個人」へと向けられます。採用の見送りや支援の打ち切り、保険料の引き上げといった決定は、個人の生活に決定的なダメージを与えますが、組織側にとっては統計上の微々たる誤差に過ぎません。

一度下された判定を覆すことは極めて困難であり、本人が被る不利益は事実上、不可逆なものとなってしまいます。 さらに深刻なのは、AIが出力するスコアやランクが、あたかも「絶対的な正解」であるかのような錯覚を生んでしまう点です。

数値化された結果は、人間の主観よりも客観的で正しい根拠に見えるため、運用する側は深く疑うことなくその判断に従い、思考を停止させてしまいます。これにより、もし誤りがあったとしても「システムが決めたことだ」という責任の回避がまかり通るようになります。

本人も「どこが違うのか」「何を直せばいいのか」が分からず、異議申し立ても難しくなります。 その一方で現場は、「AIがそう言ったから」で責任を軽くできてしまう。つまり、間違いが起きても、誰も説明しないまま決定だけが通る。ここで起きているのは、AIの精度の問題というより、推測をそのまま決定にしてしまう仕組みと、説明責任が消えていく運用の問題です。

予測AIに課された最大の制約は、驚くほど単純です。未来は、そもそも当てにくい。 だから「当たる前提」で制度に組み込むと、どこかで必ず外れます。そして問題は、外れること自体よりも、外れたときの影響が人の人生に直結する点にあります。

ここで必ず持ち出されるのが、「今は不完全だが、そのうち良くなる」という説明です。たしかに改善は起こり得ます。ですが、改善する可能性があることと、いま重要な判断をAIに置き換えて運用してよいことは別問題です。将来の進歩を理由に、現時点の導入を正当化してはいけません

企業はAIをどう活用すべきか?

インチキAIを売る企業がひとつ残らず倒産しても、欠陥を抱えた組織はきっと、同じようにお手軽な解決策を謳う、別のタイプの蛇油に頼るだけだろう。

著者たちは、インチキAIを売る企業が繁盛する背景には、売り手だけでなく買い手の側にも問題があると指摘します。たとえインチキAIが市場から一掃されたとしても、欠陥を抱えた組織は別の「お手軽な解決策」に乗り換えるだけだ、というわけです。

焦点は供給側のAI企業ではなく、需要側――つまり「都合のいい外部の判断装置」を求めたくなる組織体質にあります。 この前提を踏まえると、AIの位置づけも自ずと定まります。AIは判断の代行者ではなく、判断材料を増やす道具にとどめるべきです。ここを取り違えると、AIは便利な支援ではなく、責任回避の装置になります。

本書の中心メッセージは明快です。AIの危険は、AIそのものよりも、AIをめぐる誤解と誇張にあります。できることの範囲が曖昧なまま、AIが「正しそうに見える」形で意思決定に組み込まれ、そこから実害が生まれる、という見立てです。

同じ整理は、「仕事」をめぐる議論にも当てはまります。AIが大量失業を招くという悲観論と、AIで生産性が一気に上がるという楽観論がメディアやSNSで交錯します。どちらも物語としては分かりやすいですが、現実はその中間にあります。

AIが既存の仕事を一気に消し去るというより、まず置き換わるのは“仕事そのもの”ではなく、仕事の中の無駄や手間です。その結果として、私たちの働き方がAIの進化とともに組み替わっていきます。ある職種は縮小し、別の職種は拡大し、さらにAIの普及が新しい役割や仕事を生み出します。重要なのは、AIで何が自動化され、何が人に残り、どこに新しい需要が立ち上がるのか――そこを見極めることです。

この見取り図を補助線として照らしてくれるのが、メアリー・L・グレイとシッダールタ・スリの『ゴースト・ワーク』で語られる「自動化のラストマイル」です。新しい自動化技術が導入されるたび、表向きは機械が代替しているように見えても、裏側では機械を成立させるための人間の労働が別の形で必要になります。しかもその労働は、見えにくい形で外部化されやすいのです。

だからAI導入は、目に見える効率化だけで評価すべきではありません。裏側で増える作業、追加されるチェック業務、そして責任の所在まで含めて考えなければ、コストの計算や組織の設計を誤ります。

そしてAI活用の前提は、主体性です。AIに丸投げするのではなく、限界を理解したうえで、判断と責任は人間が持ち続けるべきです。導入は管理された環境から始め、検証と改善を回しながら、必要なスキルを組織に蓄積していきます。便利さは魅力的ですが、運用を取り違えた瞬間に、顧客や従業員にリスクをもたらします。

本書が優れているのは、生成AIを一括りに否定していない点です。予測AIの誇張を批判しつつ、生成AIには別の可能性があることも認めます。生成AIは未来を当てるよりも、文章を書く、要約する、翻訳する、アイデアを出す、コードを補助するといった知的作業の支援に向いています。

人間の判断を置き換えるというより、作業を速くし、選択肢を増やし、手戻りを減らす方向で効果を得られます。 今後の生成AIは、「ChatGPTを開く」といった意識的な利用を超えて、デジタルインフラの一部になっていきます。実際、最近のClaudeの進化は、多くの業務を劇的に改善しています。検索の回答補完、会議メモの自動要約、文書作成支援など、見えないところで知識労働の相当部分を支えたり、置き換える存在になっています。

ただし、ここでも冷静さは必要です。生成AIが便利になっても、予測AIの誇張や害が消えるわけではありません。むしろ、AIが日常に組み込まれるほど「AIなら正しいはず」という安易な信頼が生まれやすくなります。人間はこの状況を打破しなければ、AIの導入はうまくいかないのです。

コンサルタント 徳本昌大のView

AIをめぐる議論は、なぜか両極端に振れがちです。「推進か、規制か」「希望か、恐怖か」。どちらも分かりやすい物語ですが、現場のコンサルティングで見えるのは、AIの導入を急いだことで、いちばん重要な問い――そのAIは何を解決できて、何は解決できないのか――が置き去りになるということです。

とくに予測AIは、「入れるか、入れないか」を急ぎやすい領域です。導入の是非が先行すると、用途の切り分けや前提条件の確認が後回しになり、効果検証も曖昧になります。すると「何でもできます」と言い切るスネークオイル(予測AI)が入り込みやすくなるのです。

AIがそれっぽい答えを出すほど、「AIがそう言った」という免罪符が生まれ、判断の主体がじわりとAIへ寄っていきます。結果として、組織の問題は解決されるのではなく、AIの背後に隠れて先送りされてしまいます。 最後に強調したいのは、AI導入は「IT投資」ではなく、意思決定の設計変更だという点です。

ツールが賢くなるほど、「判断もAIに任せたい」と思ってしまいます。けれど任せ方を間違えると、AIは仕事を速くする道具ではなく、責任をあいまいにする仕組みになります。スネークオイルが効いて見えるのも、だいたいこの場面です。実際には成果が出たのではなく、面倒な検討を省いて「AIが決めたことにした」だけなのです。

こうして起きるのが、AI過大評価です。AIの性能が上がったからではなく、組織の側が「判断の外注」をしたくなった結果として、AIが必要以上に信じられてしまう。だからこそ、AI導入はツール選定ではなく、意思決定の設計から始めるべきです。

AIがインフラ化する社会では、競争優位は「AIを使っているか」ではなく、AIをコントロールできているかで決まります。出力をどう扱うかを決め、誤りを前提に止めて直せるようにする。AIを疑う能力は、現場の慎重さではなく、経営の統治能力そのものです。

だから結局、やるべきことはシンプルです。AIを盲信しない。判断を外注しない。どこまでをAIに任せ、どこからを人が握るのかを明文化する。そうして初めて、AIは“万能薬”ではなく、意思決定の精度とスピードを底上げする実務ツールになります。

コメント